智东西11月14日报道 据彭博社报道,据知情人士透露,OpenAI最新模型Orion在开发过程中未能达到预期性能,尤其是在编码任务上未能超越上一代产品GPT-4;谷歌的Gemini模式也未能取得重大突破; Anthropic的Claude 3.5 Opus模型因技术困难推迟了发布计划,并多次调整发布时间。

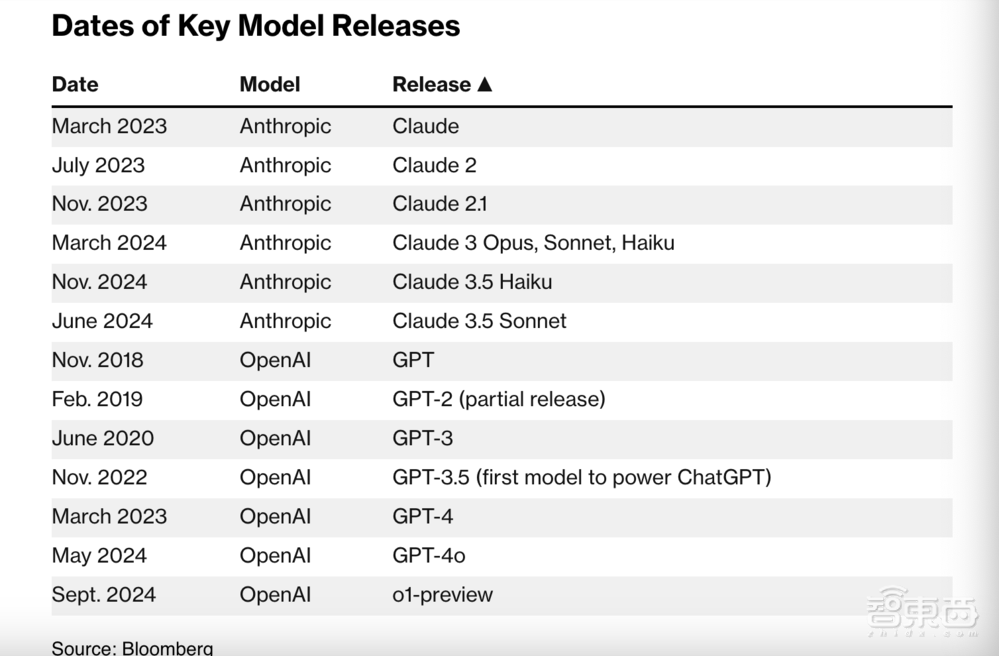

▲主要AI模型发布日期(来源:彭博社)

过去,业界普遍遵循Scaling Law,认为随着数据量和计算能力的增加,模型性能也应该提高。基于这一理论,这些公司投入巨资建设AI基础设施、扩建数据中心、采购大量GPU用于训练。然而,随着训练节奏放缓,继续依赖这一策略的可行性开始受到质疑。

近年来,OpenAI、谷歌以及美国AI大模型独角兽Anthropic在极短的时间内推出了大量复杂的AI模型。然而,由于缺乏高质量数据,这些公司的模型开发速度和性能都出现了明显放缓,甚至未能达到预期效果。

OpenAI首席执行官萨姆·奥尔特曼两周前表示,未来的突破可能不是模型大小的简单扩展,而是新应用程序和用例的开发,例如AI代理。

OpenAI、Google、Anthropic在构建新一代AI系统时都面临着类似的问题:高质量的数据,尤其是编码数据,越来越难以获得。在这种情况下,即使是微小的改进也很难证明新车型所需的巨额研发投资是合理的。

最近的困难表明,仅仅依靠扩展已经无法实现预期的技术飞跃。业界对于实现AGI(通用人工智能)可行性的信心也开始动摇。

人工智能初创公司 Hugging Face 的首席道德科学家玛格丽特·米切尔 (Margaret Mitchell) 表示,AGI“泡沫”正在破裂。现有的训练方法可能无法满足人工智能在多任务处理方面的需求,迫切需要新的训练方法。应对这一挑战的培训方法。

▲AI初创公司Hugging Face首席伦理科学家玛格丽特·米切尔(Margaret Mitchell)(来源:彭博社)

目前,OpenAI 仍处于“训练后”Orion,并试图通过添加人类反馈来提高其性能。不过Orion的正式发布还没有明确的时间表,明年初推出的可能性不大。

谷歌DeepMind回应称,虽然Gemini模型的进展符合预期,但该公司表示将在准备好后分享更多细节。 OpenAI 拒绝置评。至于Anthropic,首席执行官Dario Amodei在播客中表示,Scaling Law不是宇宙法则,而是经验法则。尽管“许多因素”可能会影响人工智能的发展,但他仍然致力于克服这些障碍。乐观。

▲Anthropic CEO Dario Amodei(图片来源:彭博社)

随着社交媒体帖子、在线评论、书籍和其他公共数据源的消耗,人工智能公司面临着前所未有的高质量数据短缺。为了构建超越人类的AI系统,这些公司需要的不仅仅是维基百科和YouTube字幕等基础数据,而是更广泛和高质量的数据集。

以OpenAI为例,虽然该公司与出版商签订了协议,保证其数据源的高质量,但随着AI技术的不断进步,出版商和艺术家对内容知识产权的保护越来越严格,这使得AI风险也加大了企业面临的法律压力。为了弥补数据的不足,许多公司开始招聘研究生学历的人员,尤其是数学和编码领域的人员,以便更准确地标记和训练与特定学科相关的数据,以便AI系统能够更好地做出反应专业领域的查询。

然而,这个过程缓慢且成本高昂。与从网络上抓取大量公开数据相比,在专业领域获取和注释高质量数据的成本显着增加。与此同时,为了填补数据空白,许多公司也开始尝试合成数据,例如计算机生成的图像和文本。然而,这种方法仍然面临许多挑战,特别是在确保数据质量和多样性方面。

美国风险投资公司New Enterprise Associates人工智能战略主管Lila Tretikov表示,数据问题不仅仅是数量问题,还涉及质量和多样性。如果没有人类的指导,尤其是在语言处理领域,将很难获得独特且高质量的数据集。

2、“多多益善”不再有效,让AI公司陷入困境

许多AI公司坚持“越多越好”的策略,投入大量资源,希望构建接近人类智能的AI系统。但随着计算资源和数据的成本不断上升,新模型开发的风险和期望也在不断上升。 Anthropic首席执行官Amodei在播客中透露,该公司预计今年将花费1亿美元来训练尖端模型,未来几年这一金额可能达到1000亿美元。

随着成本不断上升,很多人开始对AI模型进展的速度产生怀疑。马萨诸塞州沃尔瑟姆本特利大学数学副教授诺亚·吉安西拉库萨表示,尽管人工智能模型将继续改进,但增长速度和技术突破的可持续性值得怀疑。快速的技术进步在短期内令人兴奋,但这种增长模式是不可持续的。

硅谷AI技术进步的困境成为焦点。今年3月,Anthropic发布了Claude Opus模型,声称该模型在推理和编码等领域超越了OpenAI的GPT-4和谷歌的Gemini模型。然而,到了 10 月份,Opus 推出的消息突然从该公司网站上消失了。

据知情人士透露,Anthropic在Opus的开发过程中遇到了很多挑战。虽然 Opus 在某些基准测试中表现良好,但鉴于其庞大的模型规模以及构建和运行的高昂成本,它最终没有达到预期的性能。即便如此,Anthropic CEO Amodei 表示,他并没有放弃继续推广 Opus 模式,但没有给出具体的发布时间。

与此同时,谷歌和OpenAI也面临着类似的困难。尽管谷歌更新了Gemini模型,提供了更多实用功能,但并没有带来重大的技术突破。 OpenAI 专注于增量更新,例如改进语音助手功能,使与 ChatGPT 的对话更加顺畅。 OpenAI还推出了名为o1的模型预览版,旨在提高推理过程的质量,但技术突破仍然有限。

随着开发下一代AI模型的成本不断增加,AI公司开始面临一个重要的权衡:继续改进现有模型,还是投入更多资源开发更大、更复杂但可能不会出现的下一代模型带来重大突破。模型。

OpenAI 首席执行官 Sam Altman 最近在 Reddit 问答中表示,虽然该公司拥有充足的潜力和资源,但也面临“艰难的决策”和“计算能力的限制”。他还表示,未来的突破可能不是简单地扩大模型规模,而是开发新的应用程序和用例,例如AI Agent,它可以代表用户完成日常任务。

在此背景下,OpenAI的重点逐渐从提高模型单一能力转向更实际的应用场景,尤其是智能体AI工具的探索。奥特曼表示,这些人工智能工具将帮助用户完成日常生活中的复杂任务,例如预订航班和发送电子邮件。虽然AI模型会不断变得更加强大,但未来真正的突破可能不再是简单的模型更新,而是更多创新的功能和应用。

结论:AI创新应用成为未来方向

这些公司在模型研发上投入了大量资金和计算资源,但新一代AI模型的性能提升却远远低于预期。在成本压力日益加大的情况下,如何平衡创新与投资已成为共同挑战。

随着数据和计算资源日益稀缺,人工智能发展的“规模革命”正接近瓶颈。未来的突破可能不再集中在模型规模的扩大,而是创新应用和工具的开发,比如AI Agent等功能应用。如何将现有技术在现实生活中发挥更大的价值将成为行业创新的关键。