怪月来自奥飞寺量子比特 |公众号QbitAI

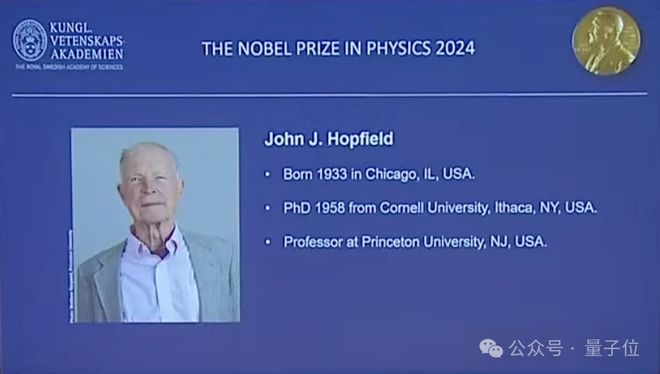

两位2024年诺贝尔物理学奖获得者约翰·霍普菲尔德和杰弗里·辛顿近日在斯德哥尔摩大学发表最新讲座。

现场气氛十分热闹!

看到霍普菲尔德教授即使拄着拐杖也到达现场并亲自发表演讲,辛顿教授也忍着背痛飞往瑞典,给观众留下了深刻的印象。

本次活动中,John Hopfield教授的演讲题目为“Physics is a Perspective”,讲述了他个人的科研经历以及做科研的思维模式。

他坦白了很多关于科学研究和他对物理的思考:

如何选择问题是科研成果的关键因素

对我来说,大脑如何产生思想是人类最深刻的问题

我认为物理学有助于理解人和世界

Geoffrey Hinton教授以通俗易懂的方式讲解了Hopfield网络和玻尔兹曼机的原理和发展,整个过程没有使用单一方程。

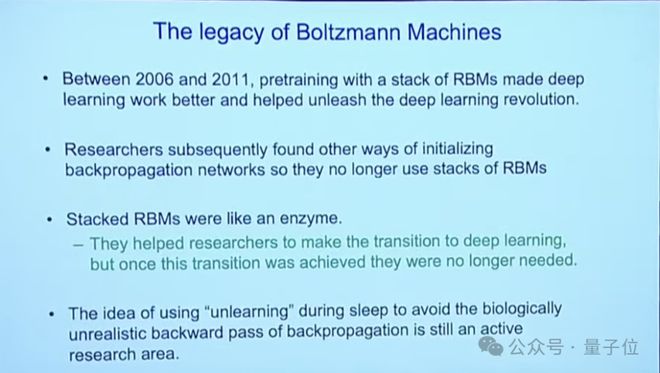

当我们最终了解大脑如何学习时,我相信睡眠的作用将非常重要,我对此非常乐观。

当两位教授结束演讲后,全场观众情不自禁地起立鼓掌。

以下为现场演讲内容。 Qubit在不改变原意的情况下,对长度做了一些调整。

约翰·霍普菲尔德:物理学是一种观点

约翰·霍普菲尔德 1933 年出生于芝加哥。1954 年,他在威廉莫尔学院获得第一个学位,1958 年在康奈尔大学获得博士学位。1964 年,他被任命为普林斯顿大学物理学教授,1980 年成为普林斯顿大学化学和生物学教授。加州理工学院,之后他回到普林斯顿大学,目前是分子生物学名誉教授。

(以下为John Hopfield教授的演讲)

我的第一份全职工作是在发明晶体管的比尔电话公司实验室的一个六人团队中。刚进实验室的时候,我在新办公室打开书籍和期刊,参观库存室获取文具,思考下一步的工作。

在科学研究中,大多数人往往是按部就班,很少深入思考研究方向的选择,而研究方向的选择才是科研成果的关键因素。我写了40多篇科学研究论文,几年前形成的工作基础最终发展成了霍普菲尔德模型。相关的想法来源于对随机事件的分析。

我在一个物理学家家庭长大。我从小就受到物理概念的影响。我喜欢探索事物的原理,比如拆自行车、做化学实验。这使我能够了解复杂系统的运作。当我上高中时,我有一位优秀的化学老师,但我的物理老师对电磁原理了解甚少。这影响了我对大学专业的选择,但最终我决定在斯沃斯莫尔学院主修物理。

进入物理学研究生院后,我在康奈尔大学学习,在那里我与阿尔伯特·奥弗豪泽合作,从他的研究清单中选择了与晶体中激子辐射寿命相关的问题开始研究。获得博士学位后,在理论组工作,后来结识了化学家David G. Thomas,成立了理论实验联盟,取得了成果,获得了奥利维尔·巴克利固体物理奖。

之后,我的研究遇到了瓶颈,前往剑桥大学寻找新的方向。回到普林斯顿后,我担任半导体组的顾问,接触到了血红蛋白相关的实验,这为我提供了从凝聚态物理转向生物物理学的机会。 Linus Pauling 的观点也给我带来了启发。研究蛋白质合成问题并取得成果。

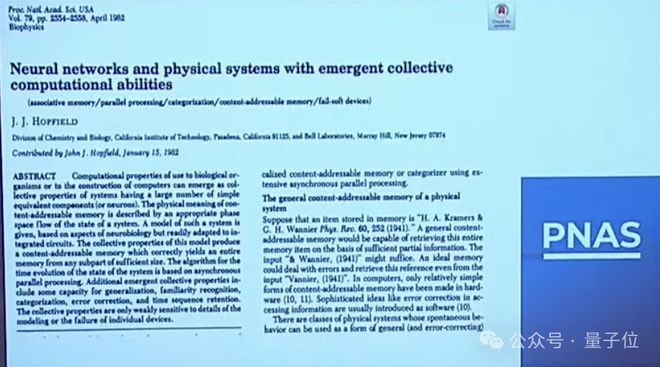

1974年的论文影响了我对生物学问题的研究思路,促使我思考神经元网络的特性。 1977 年哥本哈根研讨会结束后,我寻求跨学科突破,并受邀参加神经科学会议。虽然当时我对此一无所知,但后来我加入了这个项目,从神经生物学中获得灵感。

1979 年,我晋升为化学和生物学教授,在那里我发现了学科联系,提出了新的计算见解,并撰写了一篇推动该领域发展的论文。

后来我发现了Hopfield模型的网络问题。 2015年,我与他人合作提出了密集联想记忆模型,希望能够推动人工智能的发展。

我非常尊重各领域的专家,并积极参与跨学科的互动。我相信物理学有助于理解人类和宇宙。

Hinton:Hopfield 网络和玻尔兹曼机的发展

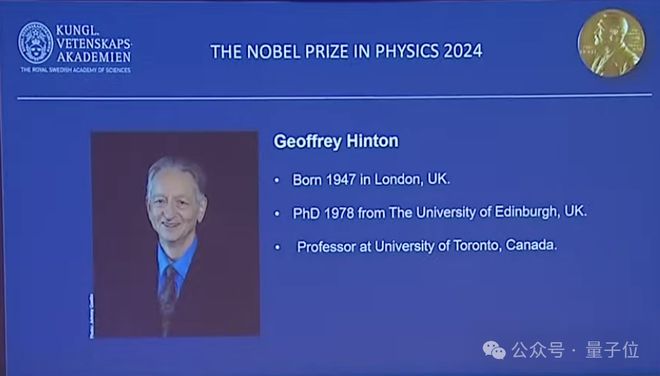

杰弗里·辛顿 (Geoffrey Hinton) 1947 年出生于英国伦敦。他在剑桥大学获得实验心理学博士学位。曾在爱丁堡大学从事人工智能博士后研究,并在多所大学工作。目前从事学术研究并在谷歌工作。

(以下为Geoffrey Hinton教授演讲)

今天我将在不使用任何方程的情况下向普通观众解释 Hopfield 网络。

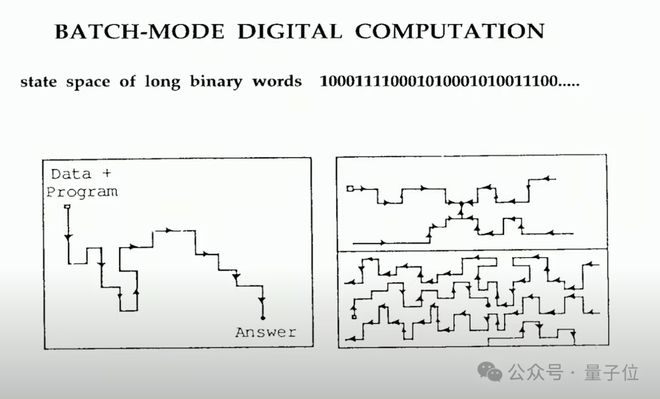

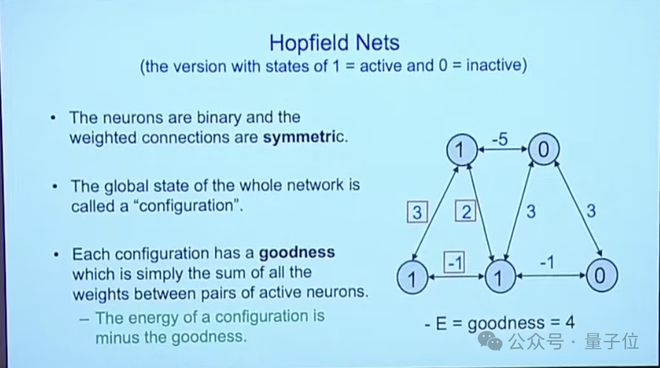

让我们首先看一下小型 Hopfield 网络的二元神经元版本。神经元之间存在对称加权连接。网络的全局状态是配置。配置具有良好性(单元对的权重之和)。能量是善的反面。网络将稳定在能量最小值。

Hopfield提出用能量最小值来对应记忆,通过二元决策规则清理不完整的记忆,实现内容可寻址的记忆。

特里·西诺夫斯基和我提议使用网络来构建对感官输入的解释。该网络包含可见和隐藏的神经元。可见部分接收感官输入(例如二进制图像),而隐藏部分则构建解释。能量代表了解释的好坏程度。我们需要低能量。解释。

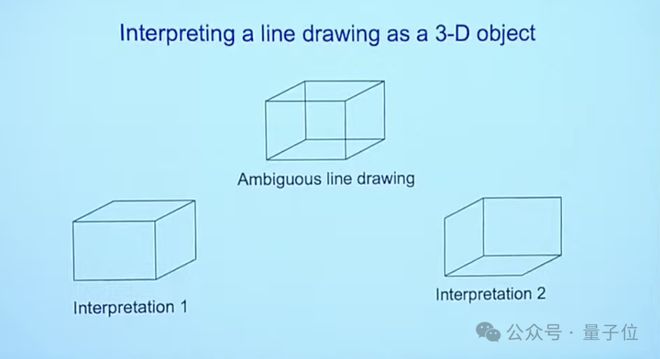

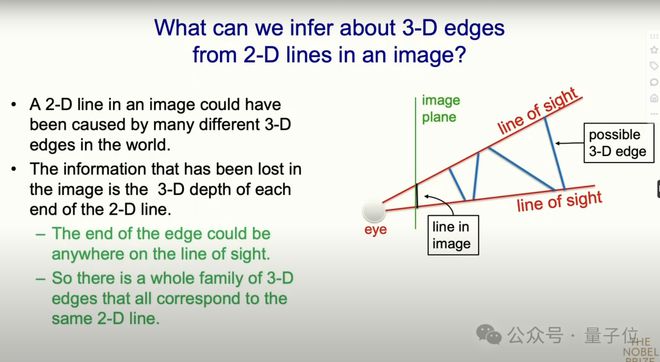

以线图为例,有不同的三维解释,我们希望网络给出解释。

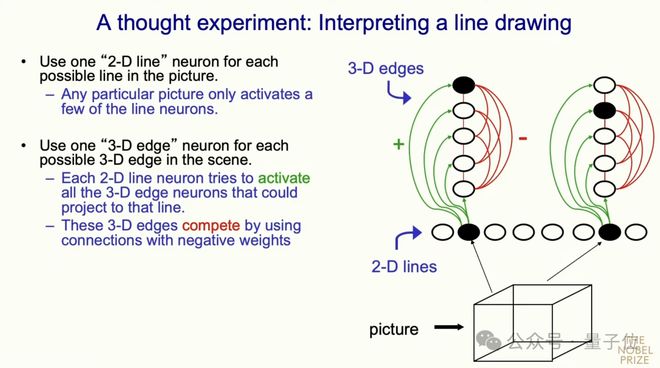

首先,将线转换为线神经元以进行激活。线神经元连接到三维边缘神经元。边缘神经元通过考虑感知光学因素相互抑制。连接也必须根据图像线连接原则来建立。希望通过设置连接强度,网络能够解决这两个问题。另一种解释。

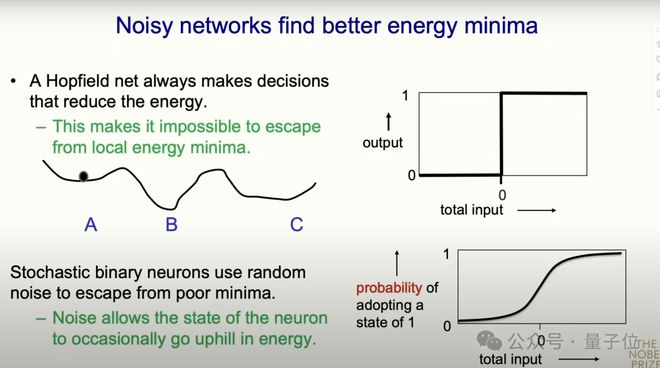

这就产生了两个问题:一是避免陷入局部最优搜索问题;二是避免陷入局部最优搜索问题。另一个是神经网络自动学习连接的问题。

对于搜索问题,我们通过使神经元变得嘈杂来解决它,其中神经元状态是二元的,但决策是概率的。

使用隐藏神经元解释二值图像时,将图像固定在可见单元中,根据输入随机选择隐藏神经元确定其状态,继续运行使系统达到热平衡。此时,隐藏神经元的状态是一个平衡的解释,网络学习正确的权重,使低能量的状态对应于更好的解释。热平衡是系统在概率分布(玻尔兹曼分布)上稳定,低能量构型概率较高。

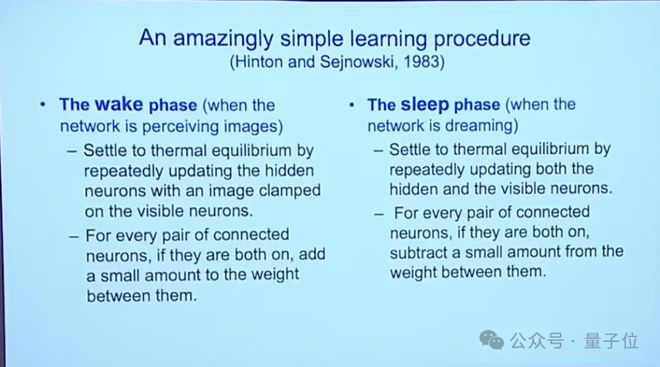

玻尔兹曼机器学习的目的是让网络生成的图像与其感知的真实图像相似。它有一个简单的学习算法,包括唤醒和睡眠阶段。

在唤醒阶段,图像被固定到可见单元,并在隐藏单元达到热平衡后调整连接权重。睡眠阶段,类似于做梦,更新神经元,达到热平衡后反向调整重量。平均而言,该算法可以使网络生成类似于感知图像的图像过程,涉及对数。似然梯度的概念使网络通过改变权重来关注唤醒阶段看到的数据。

但玻尔兹曼机存在问题。当重量变大时,热平衡过程缓慢。虽然想法很好,但是算法太简单了。它可以做复杂的事情,但速度有限。

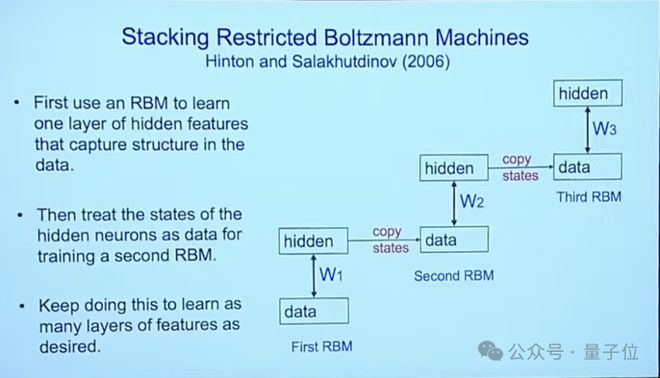

后来我发现了受限玻尔兹曼机(RBM),其隐藏单元彼此不连接。在唤醒阶段更新隐藏神经元更简单。睡眠阶段有一些捷径,虽然不完全正确,但在实践中很有效。 Netflix 使用受限玻尔兹曼机结合其他方法来推荐电影。

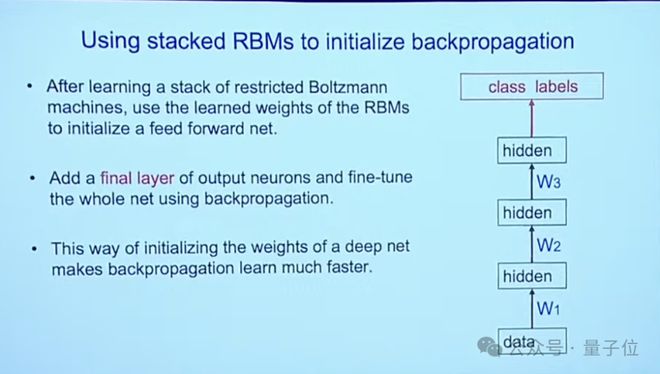

为了构建特征检测器层,可以堆叠 RBM。前一个 RBM 隐藏单元的活动模式用作下一个 RBM 的数据,以捕获复杂的相关性并学习多组权重。堆叠后,将其视为监督学习的前馈网络。就这样初始化了 在线学习比较快。因为网络已经学会了数据结构,所以后面学习事物的名称就相对容易了,比如识别物体。

还有一件事

演讲视频发布不久,要知道,LSTM之父又来捣乱了。

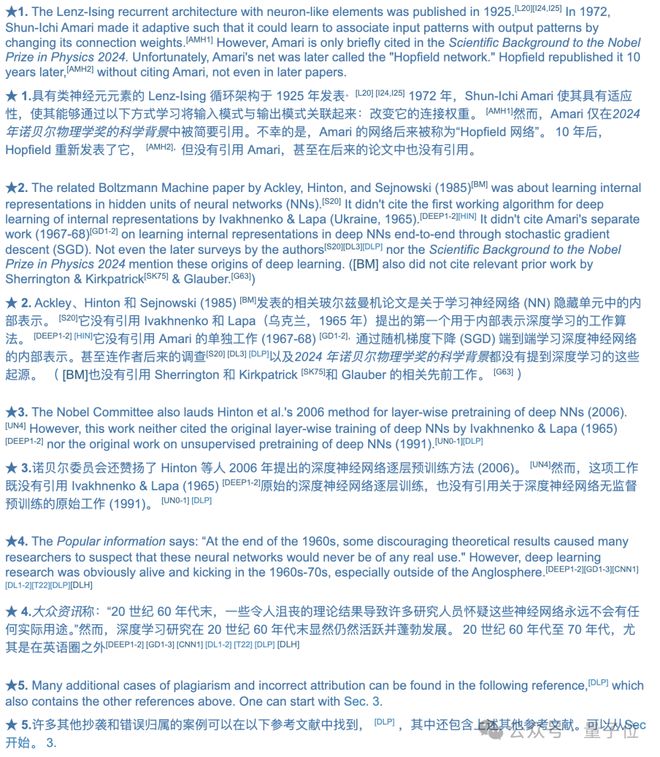

著名计算机科学家 Jürgen Schmidhuber 发推称,Hopfield & Hinton 的 2024 年诺贝尔物理学奖是通过抄袭获得的。

Jürgen 声称,这两位教授重新发表了乌克兰研究员 Ivakhnenko 和日本研究员 Amari 在 20 世纪 60 年代和 1970 年代开发的方法和其他技术,但没有引用原始作者。

目前,该帖子在 X 上已获得 2.1k 点赞和超过 44 万次浏览。

有网友表示,如果事情属实,那就比抄袭更糟糕了:

不过,也有网友认为,这就是尤尔根吃不到葡萄就说酸的心态:

尤尔根还发表了一份详细的技术报告,列出了两位诺贝尔奖获得者的工作中值得怀疑的方面。感兴趣的朋友可以点击参考链接2继续阅读。

参考链接:

[1]

[2]~juergen/physical-nobel-2024-plagiarism.html#DLP