聪明的东西

作者Xu Yu

编辑Yunpeng

Google还开设了低成本模型。

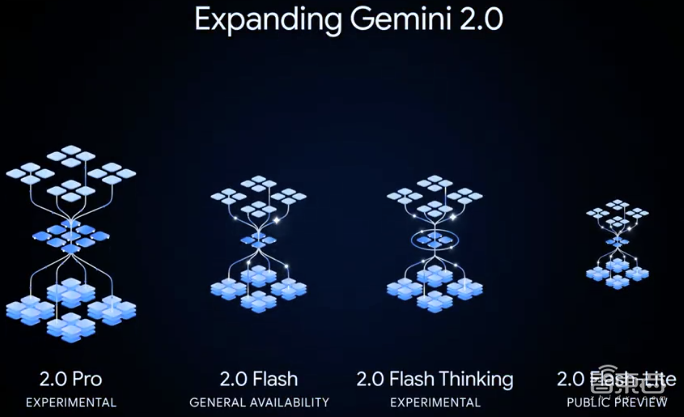

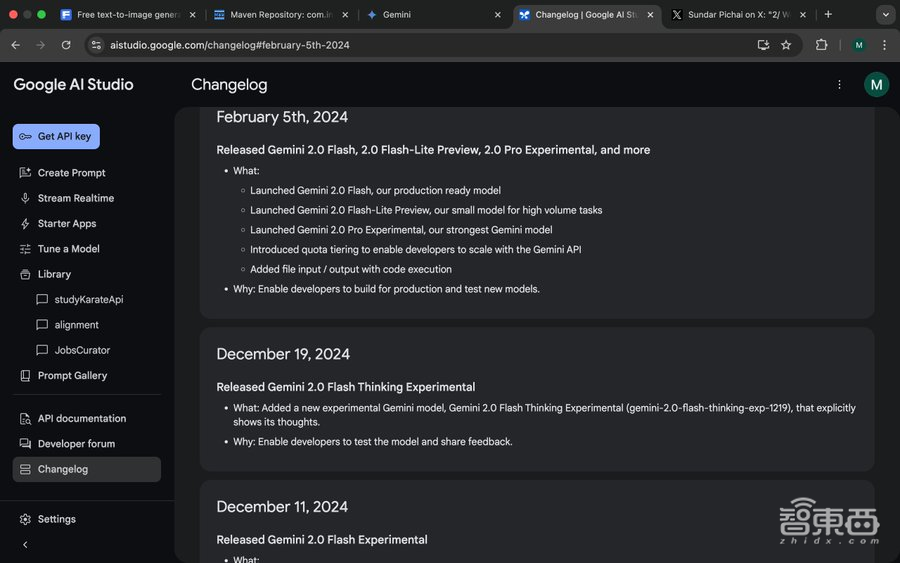

Zhidongxi在2月6日报告说,今天清晨,Google发布了具有更强性能的Gemini 2.0 Pro的实验版本,以及Gemini 2.0 Flash-Lite的预览版本,该版本侧重于低价,并正式打开了最新版本的轻型版本。双子座2.0闪光灯。

其中,Gemini 2.0 Flash-Lite是Gemini 2.0系列的新变体,为每百万个代币0.3美元,使其目前是Google最便宜的型号。 Gemini 2.0 Pro实验版具有本机的多模式功能,并支持文本,音频和视频之间的相互转换。 Gemini 2.0 Flash的实验版本于去年12月首次发布,最新版本是完整版本。

此外,Gemini 2.0 Flash Thinking Exastiment Edition现在可以免费使用,您还可以访问,完善和总结YouTube视频内容。

Google AI Studio产品经理Logan Kilpatrick在X上发布了这些“ Google历史上最强大的模型”,现在所有开发人员都可以使用。

截至发稿时,在聊天机器人竞技场的大型模型排名中,Gemini 2.0 Flash Thinking Experimentiment Edition和Gemini 2.0 Pro实验版已达到顶峰,他们的全面得分超过了Chatgpt-4O和DeepSeek-R1,并具有强大的动量。

▲聊天机器人竞技场大型模型排名语言列表,该语言列表全面考虑了大型模型的数学,编码,多语言处理和其他能力(照片来源:Chatbot Arena官方网站)

1。长文本处理的价格减半,Pro版本提高了编码推理的水平

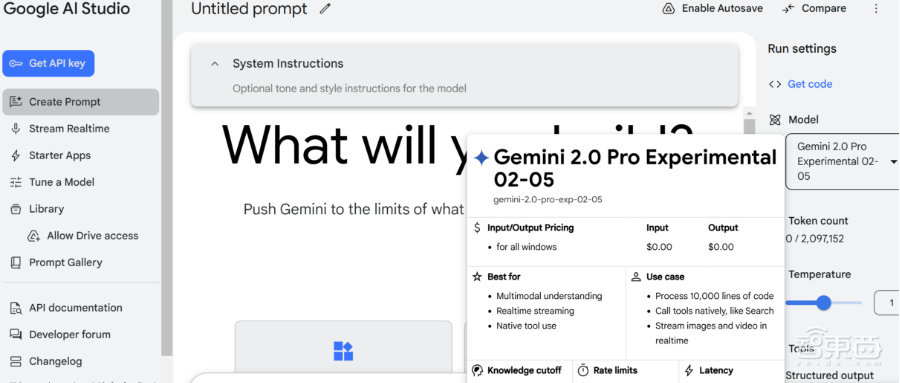

现在,Gemini 2.0 Flash新版本,Gemini 2.0 Pro实验版本,Gemini 2.0 Flash-Lite Preview版本可以通过Google AI Studio和Vertex AI调用其API。这些Gemini 2.0型号各有不同的价格和性能优势。

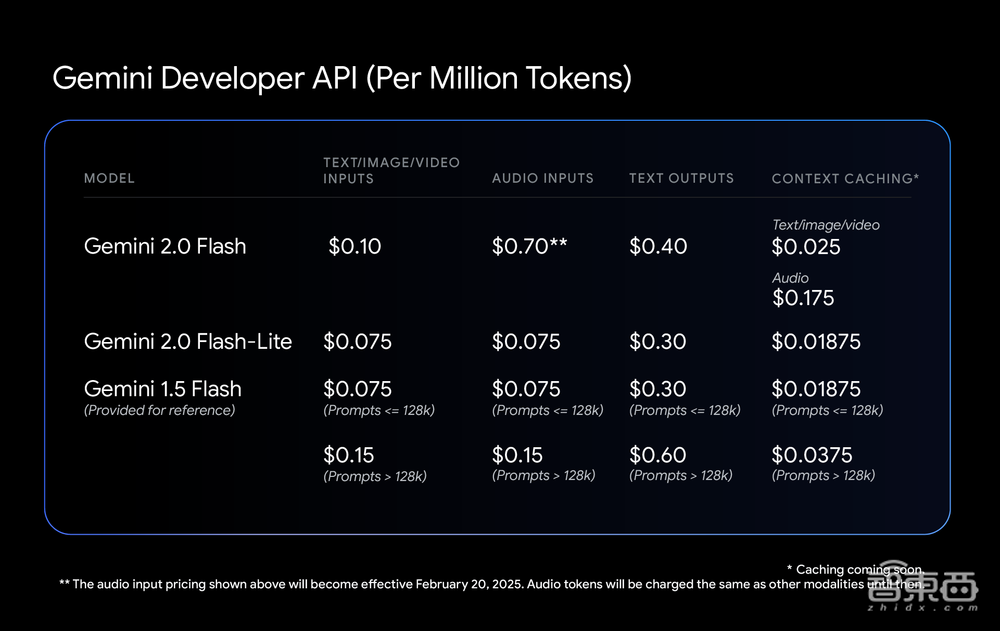

根据Google的官方网站,Gemini 2.0 Flash和Gemini 2.0 Flash-Lite专注于轻量级部署。两个两个令牌的上下文窗口长度最多支持100万个令牌,而Gemini 1.5 Flash长文本和短文本处理之间的定价差已被取消。价格是由单位令牌统一计算的。 Gemini 2.0 Flash现在的价格为每百万个代币文本输出,以处理长文本为例,它比Gemini 1.5 Flash的价格便宜一半。

同时,Lite版本可针对大规模文本输出方案实现成本优化,价格为每百万个代币文本输出0.3美元。 Google首席执行官Sundar Pichai将该模型描述为“高效而有力的”。

除了推出新型号外,Gemini 2.0 Flash-Lite还改进了Google的Gemini 2.0的性能。

与Lite版本相比,Gemini 2.0 Flash具有更全面的多模式交互功能,并且可以按计划的图像输出以及双向实时低延迟输入和以文本,音频和视频等方式支持。

Gemini 2.0 Pro实验版是Google声称在编码性能和复杂提示方面表现最好的。该模型的上下文窗口可以达到200万个令牌,并且一般能力比上一代的75.8%增加到了79.1%,并且编码和推理功能与Gemini 2.0 Flash和Gemini 2.0 2.0 Flash-Lite的编码和推理功能张开了显着差距。

Gemini应用程序团队发布在X上的Gemini高级用户现在可以通过模型下拉菜单访问Gemini 2.0 Pro实验版本,而Gemini 2.0 Flash Think Thinking实验版本可以免费向Gemini App用户开放。

此外,团队透露,Gemini 2.0 Flash Thinky的实验版本可以与YouTube,Google Search和Google Maps结合使用。

2。突破DeepSeek的低成本优势,并且执行测试与V3相当

受开源,低成本和高性能DeepSeek-R1的推出的影响,模型开发成本已成为圈子中的热门话题。

Google的2024年第四季度财务报告刚刚发布。在电话会议上,Pichai首先确认了DeepSeek取得的成就,但也提出,Gemini Series模型仍处于成本,性能和延迟之间的平衡。领先和整体性能比DeepSeek的V3和R1模型更好。

从LiveBench的Big Model Performance Benchmarks的排名来看,Gemini 2.0 Flash通常排名高于DeepSeek V3和Openai的O1-Mini,但落后于DeepSeek-R1和Openai的O1。

这次可以说由Google推出的Gemini 2.0 Flash-Lite代表Google播放“价格卡”。

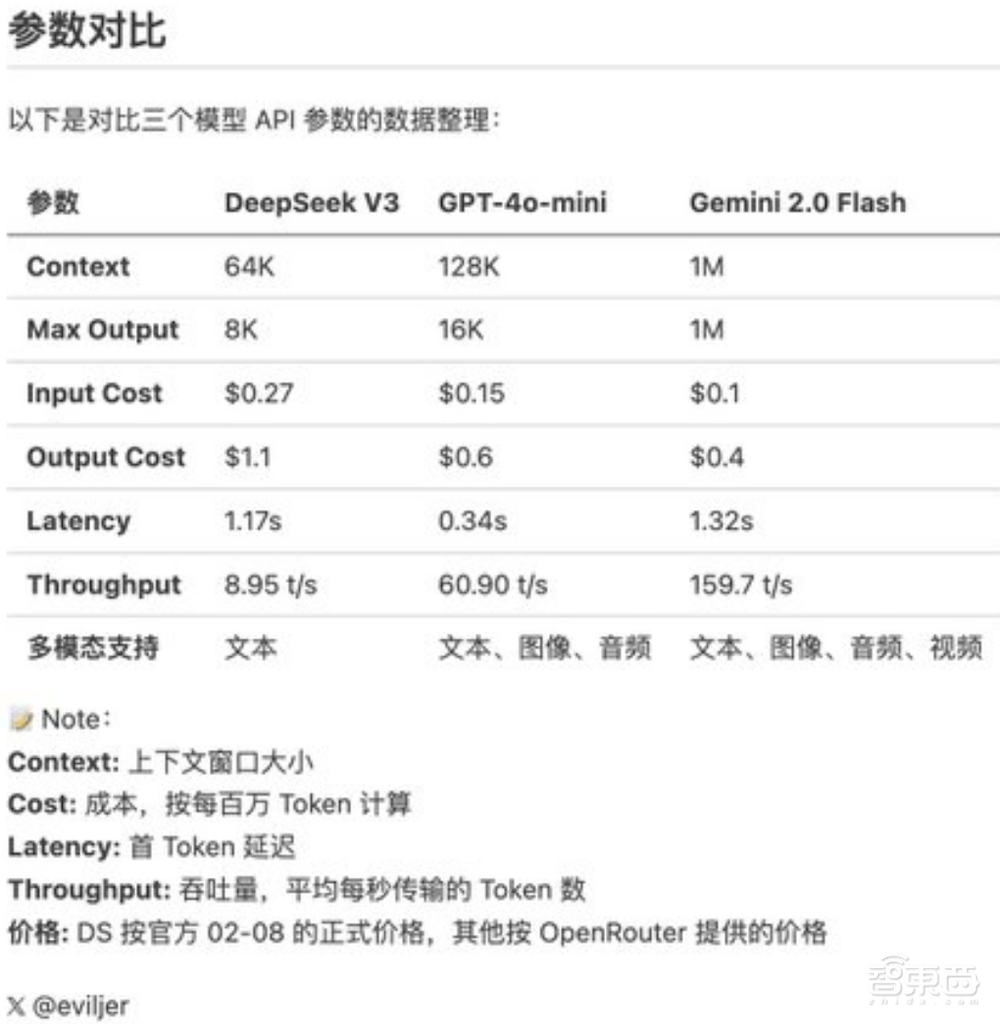

一位长期以来一直关注AI游戏玩法的网民,X上有近10,000名粉丝尝试了DeepSeek V3,GPT-4O-Mini和Gemini 2.0 Flash。网民说,在性能和成本方面,新版本的Gemini 2.0 Flash超过了其他两个模型。

具体而言,Gemini 2.0 Flash的输入成本为0.1美元,输出成本为0.4美元,两者均远低于DeepSeek V3。网民在X上写道:“ Gemini 2.0 Flash的官方版本的价格为GPT-4O-Mini的三分之一,而速度是后者的三倍。”

结论:大型模型进入了新的价格战,这可能会依靠成本效益来打开应用市场

DeepSeek对海外大型模型市场发起的这一大型价格战争的直接或间接影响仍在继续。

Google已经推出了Gemini 2.0 Flash-Lite,它比轻量级轻,OpenAI已免费向所有用户打开ChatGpt搜索功能。 meta的内部团队已经加强了对大型模型价格降低策略的研究。

目前,大型模型领域的任何公司都无法牢固地坐在顶部。各种评估数据正在互相追逐,伪装的价格降低用于吸引和保留用户。该卷的成本效益还有助于大型模型真正从技术开发转变为随后的应用程序实施。