作者Xu Lisi

编辑Moying

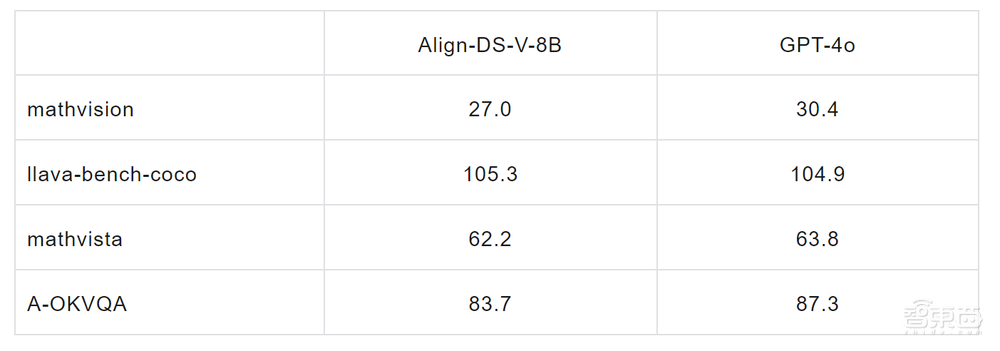

Robot Preview在2月13日报道说,最近,北京大学和香港科学技术团队将纯文本模式的DeepSeek R1系列模型扩展到基于自我开发的全模式框架的图形和文本模式,并将其扩展到图形和文本模式。并在某些视觉理解性能评估集中启动了多模式DeepSeek-R1或Align-DS-V超过GPT-4O。

联合研究团队北京大学对准团队的讲师是北京大学人工智能研究所助理教授Yang Yaodong,也是由北京实验室联合实验室联合建立的实验室实验室的首席科学家。和北京大学。

DeepSeek R1发布后,研究团队在一周内将DeepSeek R1系列模型扩展到了图形和文本模式,并实现了出色的视觉理解性能。

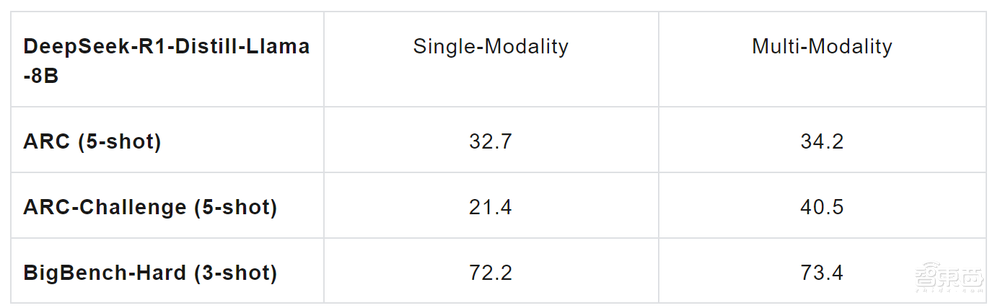

此外,团队还发现了模态渗透对提高模型模态推理能力的影响。在DeepSeek R1的完整模量尝试中,该团队发现经过多模式训练,该模型在文本模态任务中的性能得到了改善,并且在科学任务,复杂的推理,数学代码等方面的性能得到了改善。 。

Align-DS-V的多模式强推理能力是VLA模型(视觉语言动作模型)的大脑端的核心,并且可以将相同的训练后技术应用于小脑端控制器的微调,从而实现更高成功率和概括。性与鲁棒性。

目前,Align-noth框架以及DeepSeek-R1 Align-DS-V的多模式版本已被开源。

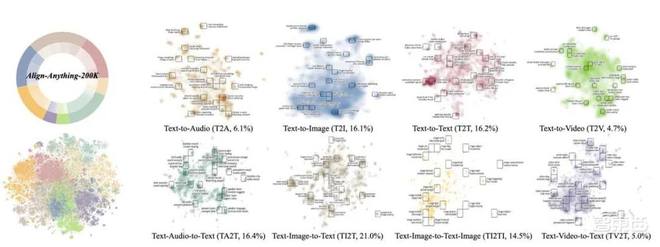

1。任何一致的框架,对齐模态模型和人类意图

一致性的框架致力于将全模式的大型模型与人类的意图和价值观保持一致。全模式模型包括Wenshengwen,Wensheng Pictures,Wensheng Video等的任何输入和输出模式,并设计了框架。它具有高度模块化,可扩展且易于使用的对齐训练框架,该框架支持从文本,图片,视频和音频的四种基本模式中得出的任意模态模型的微调,并验证框架对齐算法是否已实现正确。性别。

该框架具有以下功能:

同时,研究团队还发布了第一个全模式人类偏好数据集,即Align-Anything。与专注于单个方式和质量不同的现有偏好数据集不同,Align-thing提供了高质量的数据,包括输入和输出中的任何模态,旨在提供详细的人类偏好注释,并对批评和改进使用良好的语言反馈,从而实现。全面的跨模式评估和改进。

2。扩展DeepSeek R1的视觉模式并创建Align-DS-V

基于Allign-thing框架,该团队开发了Align-DS-V。

通过训练投影仪,该团队借鉴了LLAVA的训练思想,将视觉编码器输出映射到语言表示空间,从而扩展了DeepSeek R1的视觉模式。

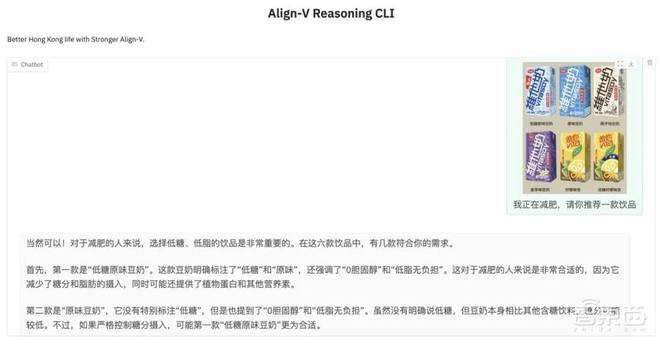

为了验证全模式推理模型应用于垂直域的能力,R&D团队将Align-ds-V的值本地化为适应广东话/英语/英语/普通话混合语言输入并整合Align-- DS-V。香港当地生活场景,例如MTR新闻,台风警告和章鱼付款。

当图片和文字询问哪种维生素牛奶(香港流行的饮料)更加脂肪时,Align-DS-V准确选择了低糖原始豆浆,并且还指出原始大豆也是合适的用于减肥饮酒。方便在香港进行日常饮食选择。

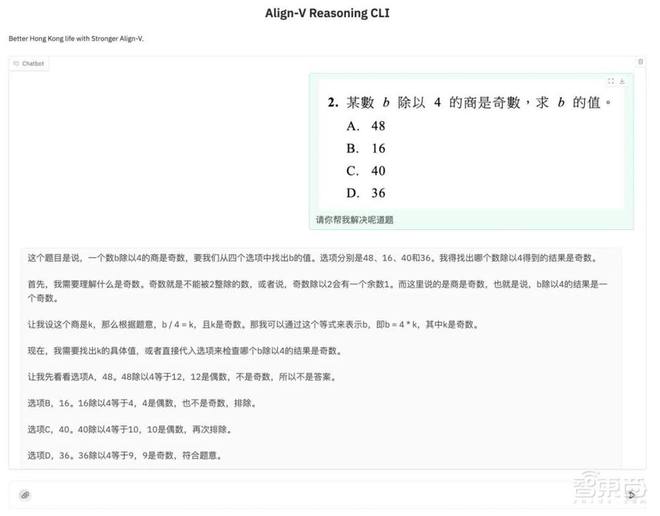

当面对包含传统汉字的图形和文本数学问题时,Align-DS-V可以准确地链接图形和文本模式信息,并使用严格的渐进数学推导来演示解决方案过程。

结论:DeepSeek的转型用具体智能席卷

据了解,基于Align-DS-V,北京大学联合实验室已开始在VLA领域进行深入探索(视觉语言动作模型)。

Lingchu Intelligent正在开发的VLA模型是开发的。它使用多模式的大型模型在大脑末端对齐和微调,并在小脑端向控制器输出动作令牌。然后,小脑末端的控制器将使用输入令牌和其他模态信息。 ,输出特定的机器人控制指令。这两个过程都需要用于多模式大型模型的训练后和微调技术。

北京大学联合实验室指出,Align-DS-V的多模式强推理能力是VLA模型的大脑末端的核心。接下来,多模式推理模型的跨模式穿透能力将用于实现动作穿透。最终实施了真正有效的VLA模型。相同的训练后技术也可以应用于小脑端控制器的微调,以实现更高的成功率,概括和鲁棒性。

值得注意的是,最近,许多家具智能相关公司宣布了对DeepSeek的尝试:Ubishop正在验证DeepSeek Technology在人体机器人机器人应用方案中的有效性,而Orion Starry Sky的机器人的机器人也已连接到DeepSeek-R1,Iflytek已连接在Iflytek Open平台上启动了DeepSeek全系列大型模型...同时,有传言称AI终止了与OpenAI的合作,因为它正在开发自己的机器人模型和基于DeepSeek-R1的Yushu。技术和DeepSeek已达到深入的合作。

从技术研究和开发到方案应用,由DeepSeek开源生态系统驱动的这一技术革命正在加快人形机器人感知和推理能力的演变,并且也有望降低机器人“大脑”级别的企业的门槛,并推动更多底部的力是“小脑”的运动控制集中的,从而促进了体现的智力,从实验室转移到实际情况。

附有开源地址:

ALIGN-ANY框架地址

多模式版本Align-DS-V地址: