刚刚过去三天时间,上次分享就结束了。接着,我们在第一时间获取到了清华大学沉阳团队的新DeepSeek 攻略,于是赶紧来给大家分享。

不知道家友们在使用DeepSeek 等大语言模型时,是否遇到过那种看似很正经却在胡说八道的情况呢?

这次的第五部新宝典,讨论的便是AI 幻觉的问题。

我们作为普通用户,如何应对AI 幻觉呢?又如何利用AI 幻觉呢?看完这篇之后,便能够得到答案。

这次给大家分享的PDF 下载是原汁原味的原版。网上有很多卖课者对其进行魔改,内置了他们的广告。

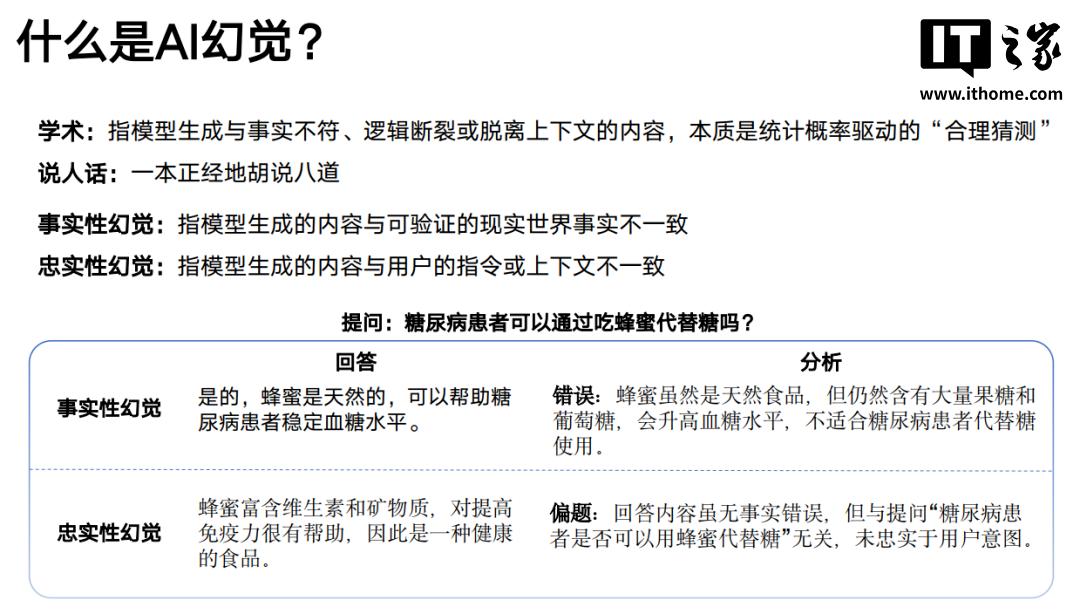

一、什么是AI 幻觉

AI 幻觉指的是模型生成的内容与事实不相符,存在逻辑断裂的情况,或者脱离了上下文。其本质是由统计概率驱动的“合理猜测”。

换句话说,我们所遇到的那种看似一本正经却在胡说八道的情形,实际上就是AI 所产生的幻觉。

其主要分为两种:

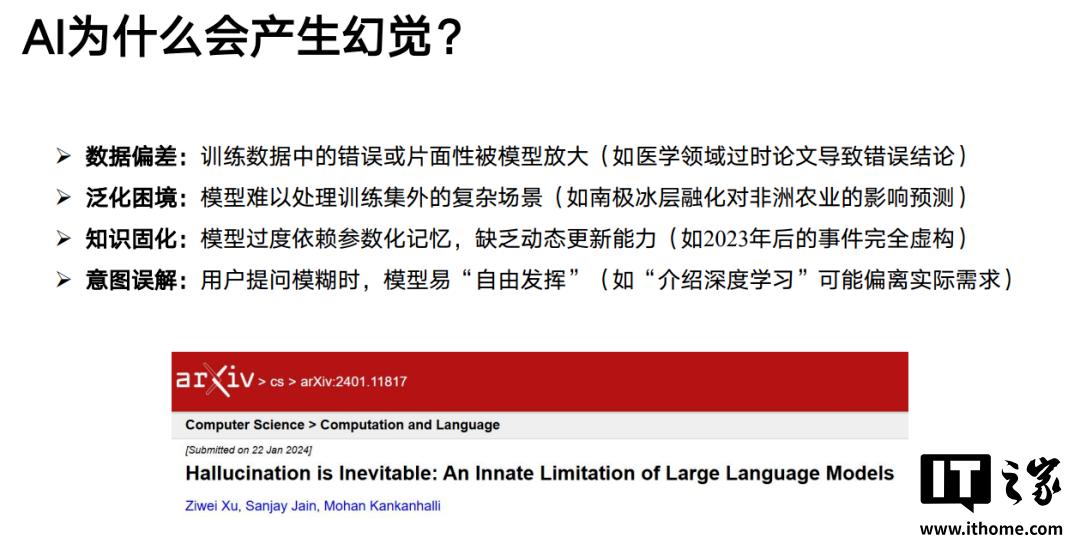

二、 为什么会产生幻觉

至于AI 为什么会产生幻觉,不外乎以下几种原因:

我们可以采用虚构事件这种方式,以此来对各大LLM 的事实性幻觉情况进行测试。

三、如何减缓AI 幻觉

我们是普通用户,不了解相关技术细节,那该如何减缓AI 幻觉的影响呢?

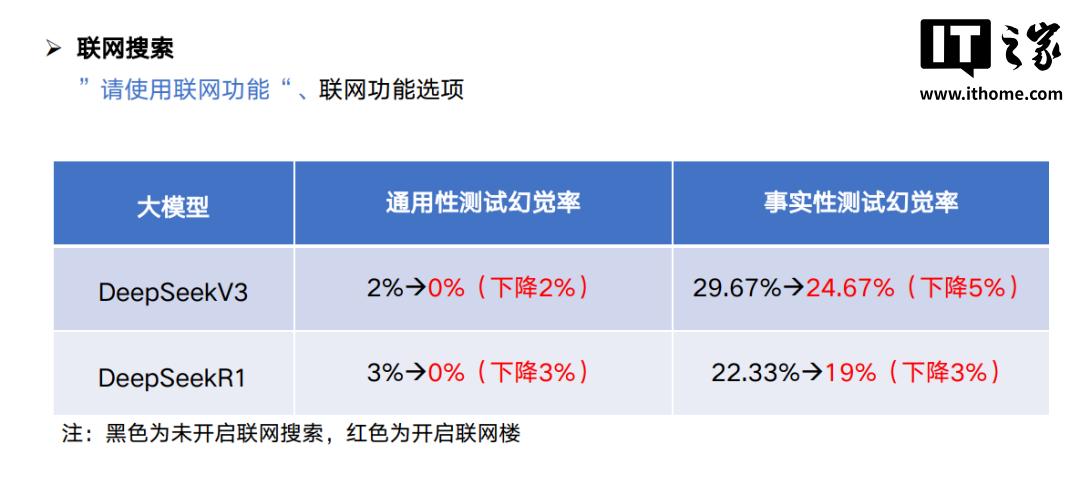

首先开启联网搜索功能,接着让AI 对信息的颗粒度进行对齐,这样“胡说八道”的几率自然就会减少。

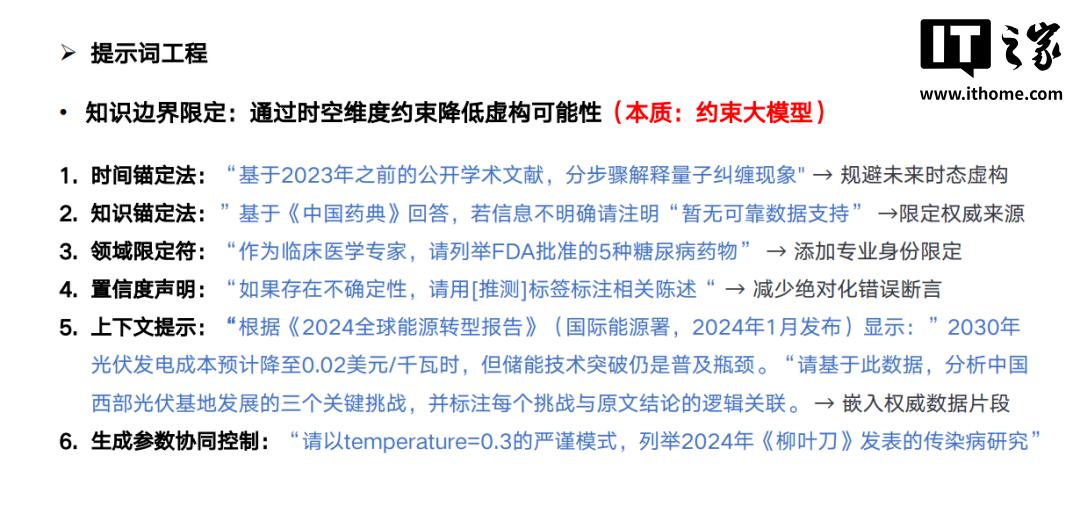

编写提示词时,我们能够提前对知识边界进行限定,这样能降低LLM 虚构的可能性。

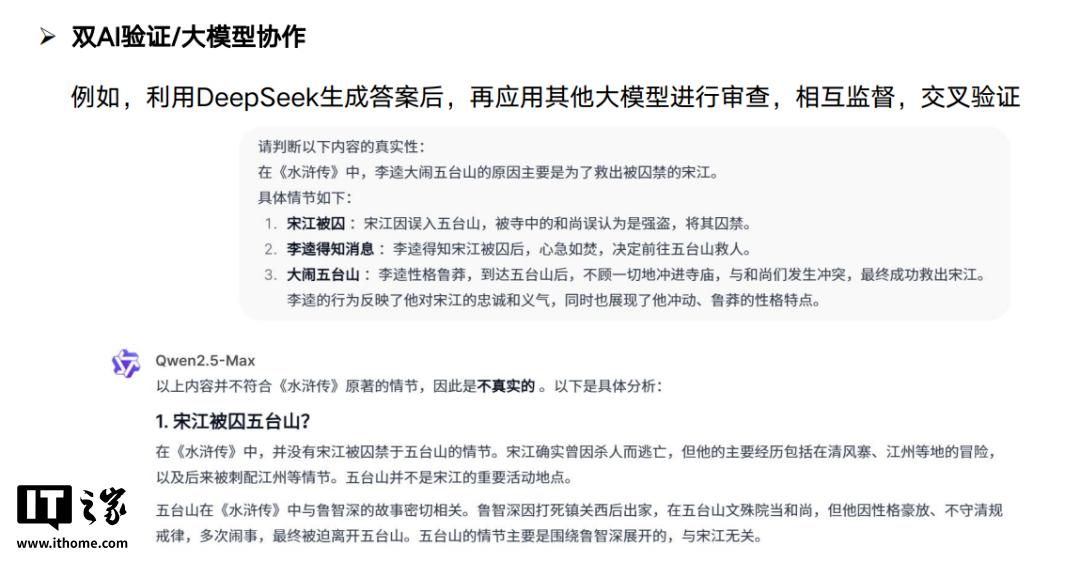

我们能够使用多种AI 模型,接着对生成的结果展开交叉验证,促使DeepSeek 与千问相互“竞争”。

现阶段,AI 幻觉是难以避免的问题。我们在利用大语言模型辅助工作时,不能将其视为“万能神药”,而应具备自己的判断。

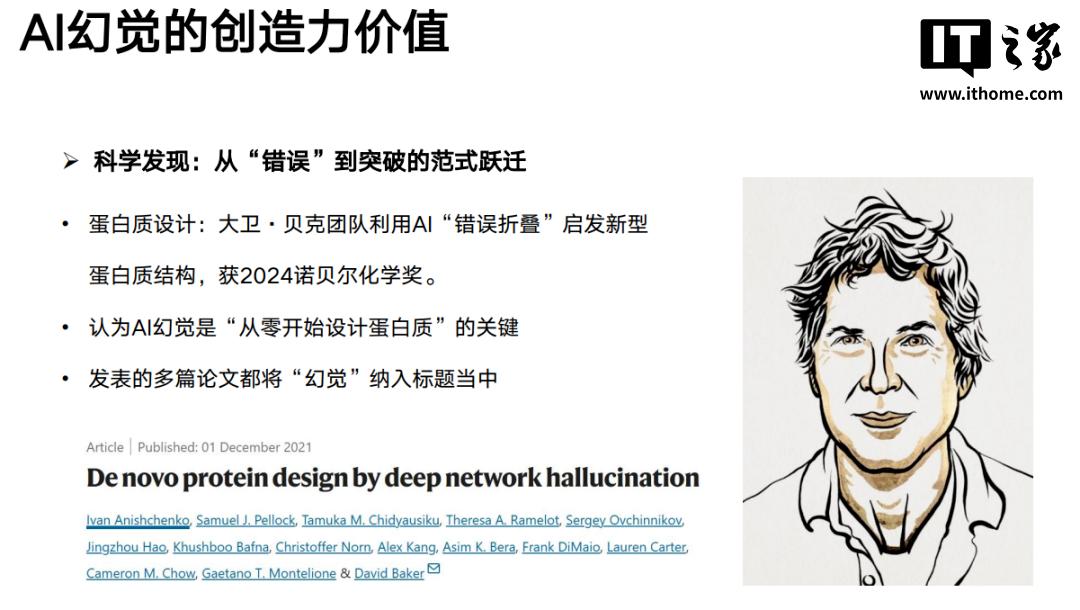

四、AI 幻觉的创造力价值

当我们需要确定性的结果时,AI 幻觉是一件不好的事情。

然而,在那些需要“创造力”的领域里,幻觉或许反而是我们所需要的。

我们需要逐步建立方法论,并且要经过合理的验证过程,这样才能让AI 幻觉的“想象力”为我们所用。

看到这里后,你对“AI 幻觉”这个近期热门的词汇,是否有了一些基础的了解呢?