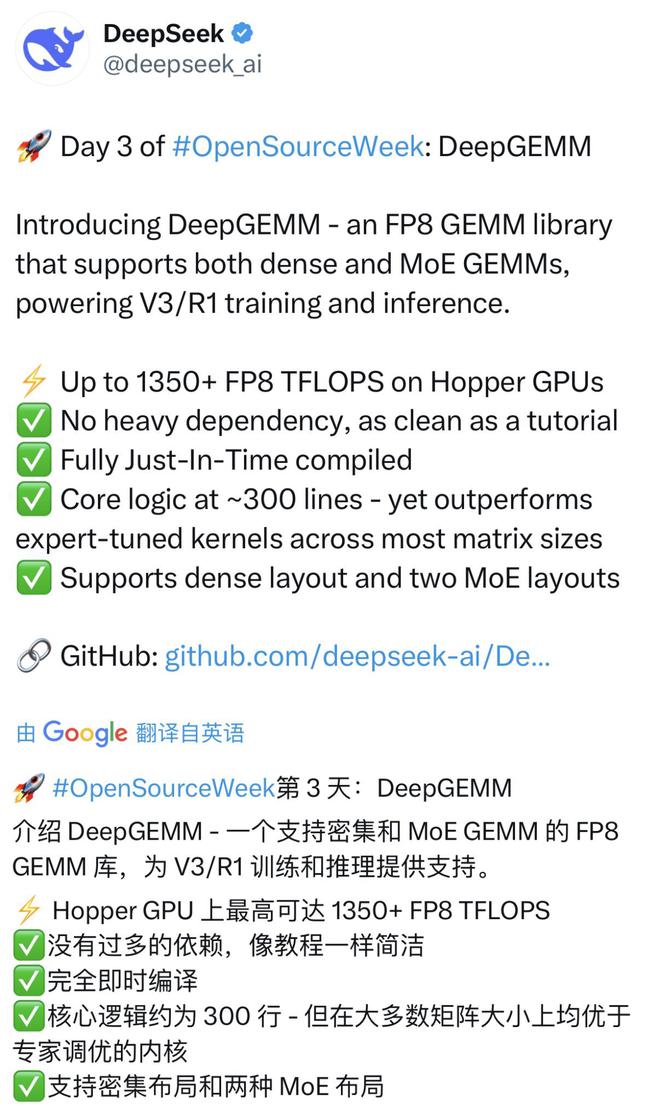

2 月 26 日,这是开源周(OpenSourceWeek)的第三日。DeepSeek 宣布了一件事,那就是开放高效的 FP8 GEMM 库 DeepGEMM。

DeepSeek 这三天发布的内容都与算法相关,且偏向技术方向。大模型生态社区 OpenCSG(开放传神)的创始人陈冉向第一财经举例说明,“就如同之前 DeepSeek 是直接给一辆车,然后告知大家这辆车续航 900 公里,而现在 DeepSeek 在深入挖掘,通过什么方式能够让车开到 900 公里。”DeepSeek 的模型能够实现较好的效果是有原因的,其中对应着一些算法和相应的框架。这些“脚手架”的开源对之后的生态搭建是有利的。

此次发布的关键词中,GEMM 指的是 General Matrix Multiplication,也就是通用矩阵乘法,它是线性代数里的基本运算。FP8 GEMM 是一种计算操作,这种操作使用 8 位浮点数来进行矩阵乘法。FP8 是一种低精度浮点格式。它适用于深度学习。也适用于高性能计算。这种格式能够在保持较高计算效率的同时,减少内存占用和带宽需求。

DeepSeek 方面介绍称,DeepGEMM 能够同时对传统的稠密模型以及 MoE(混合专家)模型进行 GEMM 运算。并且,这一代码为基于英伟达 Hopper 架构(像 H100 GPU 这样的)的 V3/R1 系列硬件给予了高效的训练和推理方面的支持。

DeepSeek 提及,依据这一代码库,在英伟达 Hopper 架构的 GPU 上能够达成 1350 多 FP8 TFLOPS 的性能,也就是每秒浮点运算次数,从而将算力充分利用起来。并且,此代码库的设计极为简洁,仅仅包含一个核心内核函数,代码的行数大约为 300 行,然而在大多数矩阵规模上都要比专家调优后的内核更优秀。

开源 DeepGEMM 的影响是什么?记者向 DeepSeek 提出了这个问题,DeepSeek 回答说,DeepGEMM 通过 FP8 以及硬件级的优化,把大模型在计算效率和资源消耗方面的痛点给解决了,尤其是为 MoE 模型的落地提供了关键的支持。它的开源行为不但加快了技术的民主化进程,还有可能成为 AI 计算生态的“基础性设施”,促使行业朝着更高效、成本更低的方向进行发展。

FP8 是 AI 计算的一种新兴标准。它具有高效性,能够加速千亿参数模型的训练,还能降低显存需求。在边缘设备或云端进行部署时,FP8 的低精度计算可以显著提升吞吐量,并且降低成本。所以,开源 DeepGEMM 能够推动 FP8 生态的普及,降低开发者的使用门槛,促进更多的框架和模型适配 FP8,从而加速行业向低精度计算迁移。

此外,MoE 模型由于其计算复杂性,在实际应用中存在落地困难。DeepGEMM 的开源为其提供了高效的实现参考,这可能会促使更多的 MoE 应用得以诞生,例如多模态模型以及在边缘端运行的高效模型。

DeepSeek 连续三天进行了代码库开源。陈冉对记者说,他们看了之后觉得很震撼。DeepSeek 的最终目标是展示他们的 R1 和 V3 是如何被制造出来的。他觉得,DeepSeek 如今发布的算法在某种程度上就像是“脚手架”。必须给大家提供“脚手架”,这样才能真正让大家依据 DeepSeek 的技术线继续向前使用,最终促使整个行业能够基于此将生态建立起来。

陈冉长期来看认为 DeepSeek 的这一开源动作很有意义。它既有模型标准,又有工具标准,还有生态基石,只有这样生态才能发展起来。

陈冉做出判断,DeepSeek 的代码开源可能会对一批从事 AI Infra 层工作的人产生影响。DeepSeek 基本上把技术栈和模型都给出来了,就差数据了。然而,其他人也有机会将数据复现出来。这样一来,AI Infra 层的人就需要去寻找新的方向了。他表示,开源具有两面性,是一把双刃剑。如果能够善用 DeepSeek 开源的内容,就可能获得利益;而如果不能用好,就会受到冲击。

有从业者向记者表示,DeepSeek 开源的部分是 Infra 层的推理加速。DeepSeek 底层技术开源对从业者会产生影响,不过或许影响不会很大。

DeepSeek 对行业产生的影响才刚刚拉开序幕,没有人能够预料到最终的结果。上述从业者如此说道。

DeepSeek 之前宣布会依次开源 5 个代码库。接下来的这周,DeepSeek 还有两个代码库要发布。DeepSeek 在公告里称,每分享出一行代码,都将成为推动 AI 行业发展的集体动力。