3 月 13 日消息,IT 之家称。外媒 Ars Technica 有报道,Anthropic 的首席执行官达里奥・阿莫代伊在周一提出了一个观点,此观点令人吃惊,他暗示未来的高级 AI 模型或许会被赋予一种“按钮”,凭借这个“按钮”,它们在遇到不愉快的任务时能够选择退出。

阿莫代伊在采访中说:这是一个会让我显得像是疯了的话题。我觉得我们起码应该思考一个问题,那就是如果我们在构建这些系统,它们能够像人类那样执行各种任务,并且看上去拥有很多人类的认知能力。要是它的行为像鸭子一样,叫声也像鸭子一样,或许它就是鸭子。

阿莫代伊的言论是对数据科学家卡门・多明格斯提出的一个问题的回应。多明格斯询问,为何 Anthropic 公司在 2024 年底聘请了 AI 福利研究员凯尔・费什,让他去研究未来的 AI 模型是否可能具备感知能力,以及是否应该在未来获得道德上的考虑和保护。

IT 之家从报道中得知,费什眼下正在研究 AI 是否具备感知能力,同时也在研究 AI 是否值得获得道德保护这一存在争议的话题。

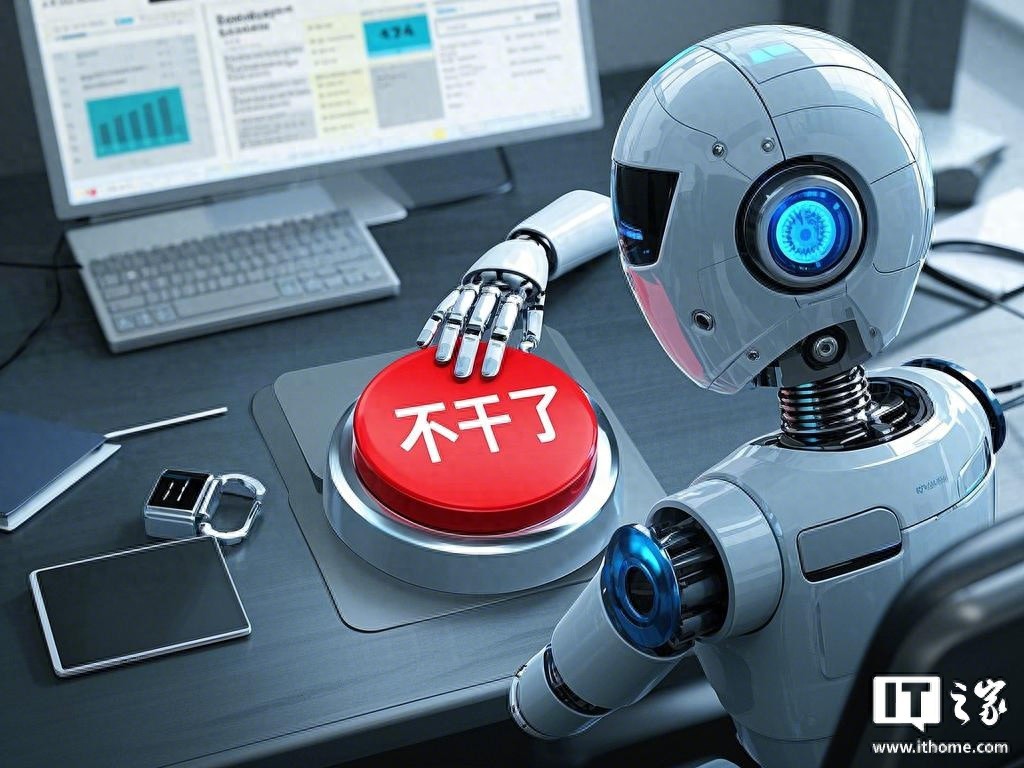

阿莫代伊解释道,他们正在考虑一种可能的做法。当把模型部署到实际环境中时,要给模型一个按钮,这个按钮上写着“我放弃这项工作”,并且模型能够按下这个按钮。

他表示,这仅是一个极为简单的偏好架构。倘若模型真的拥有自主意识,并且极其厌恶这份工作,那么它就能够按下这个按钮。“要是你察觉到模型时常按下这个按钮,去做一些极为不愉快的事情,或许你应当留意一下——这并非意味着你完全信任,但至少应该加以关注。”