AI与人类语料“大屠杀”。

文|陈梅希

编|园 长

“你看看篇文章,像不像是AI写的?”

在一个普通的工作日,我将一篇稿子发给了编辑部的同事,接着便围绕这篇稿子展开了 AI 文风的大讨论。这篇稿子仅有两千字,却出现了三个“有人认为”以及三个“有网友认为”。因为正文内容有着明显的“端水”行为,也就是先写一段正面观点,紧接着就跟一段反面观点,所以我们甚至开始猜测起这篇文本是由哪位 AI 创作的。

给 AI 断文风这件事听起来很荒谬。我们无法得知准确答案,因为去找作者问这篇稿子是由哪个 AI 创作的,实在有些冒昧。更何况,这只是一种揣测,很有可能那些“疑似 AI 创作”的痕迹,原本就来源于某位人类写作者自己的文字习惯。

我们更焦虑的是开篇那个问题答案之外的这种怀疑本身。随着 AI 生成的内容不断增多,人类渐渐意识到,自己难以准确分辨眼前的文字到底是出自一双手还是一串代码,于是一种普遍的怀疑就笼罩在了所有文字内容的上方。

编辑在邮箱里收到文学作品投稿,会怀疑它是否由AI创作。

读者在网络读到新闻报道,会怀疑它是否由AI“采写”。

用户在社交平台刷到一篇帖子。用户会怀疑这篇帖子是否是由 AI 批量生产的。用户还会怀疑这篇帖子是否是用来起号的。

打开外卖软件的客人,都需要去怀疑那些辞藻华丽的好评。这些好评充满了“食缩力”,不知道是否由 AI 生成,其目的是为了掩盖预制菜的乏味。

人类的文字内容正步入特殊的怀疑主义时代。此前在每一次大众媒介变革中,我们都曾处于或多或少的怀疑氛围里。而如今,AI 的高效使得硅基语料的传播度呈指数级增长,同时也让怀疑的情绪呈线性增长。

我没有真实的数据,这只是对类似“Scaling Law”这种表达的一种模仿。情绪无法进行统计,并且我们也已经无法将所有的 AI 语料都打捞起来,这些语料与人类语料共同存在,就如同全世界的黄豆和全世界的绿豆混合在一起一样。

鲁迅真的没说过

但我们总归需要打捞些东西,比如去探测一下 AI 编造能力的界限。就如同在武侠小说中,徒弟倘若打不过了就会请师父出场,师父要是也打不过了那就搬出宗师。我们学习文学的人,很自然而然地就会想起一些文学史上的名字,以此来安抚自己那颗被 AI 碾压得破碎不堪的心。

AI 对人类作家的风格进行模仿,它到底能不能做到以假乱真呢?我们决定展开一场单方面的测试。

五位参赛选手分别是:豆包,Kimi-k1.5,Deepseek-R1,文心一言 4.0 工具版和 GPT o3-mini。其中,除了豆包之外,其他几位选手都具备展示思考/推理过程的能力。基于此,我们能够对“AI 如何模仿人类作家”这一问题进行探究。

以鲁迅为例:

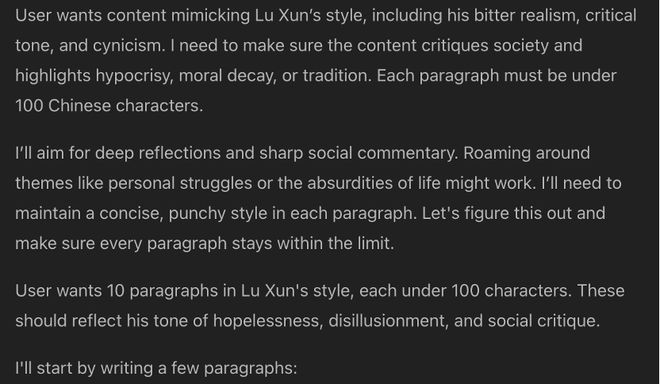

文心一言当下的推理过程较为简洁且结构清晰,具体表现为:其一,对鲁迅作品的特点进行解析;其二,生成新的内容。

这位选手从生成结果来看,似乎更注重去模仿鲁迅会关注的那些主题,然而却没有顾及到鲁迅本人所在的那个时代,也没有顾及到更微观层面的文本风格以及语言习惯。正因如此,才产生了带有很强烈穿越感的文本。

听起来很适合写进初中升旗仪式演讲稿里。

GPT o3-mini 需以其“母语”来进行思考,即便我与它对话时用的是中文,且要求它输出中文语料。从结构方面来讲,它的思考过程和文心一言相近似,也就是先将鲁迅作品“批判现实主义”“愤世嫉俗”“风格简洁有力”这些特点总结出来,然后宣称自己会“进行深刻的反思和尖锐的社会评论”。

这位“洋鲁迅”的深刻之处在于,几乎在每一段生成的内容里,都要提及他所认为的鲁迅“三件套”,不是“麻木”,就是“讽刺”,或是“苦闷”。

Kimi 的思考过程较为复杂,DeepSeek 的思考过程也较为复杂。在如何模仿鲁迅的写作风格这方面,Kimi 有更具体的执行方案,DeepSeek 也有更具体的执行方案。

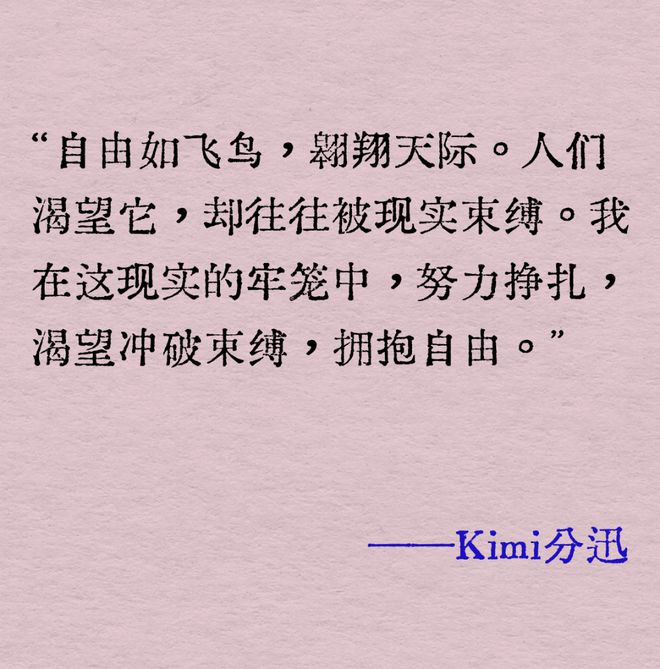

Kimi 对鲁迅风格的思考涵盖内容题材、语言风格、句式以及音韵等方面。接着,Kimi 为自己设定了“时间”“希望”“社会”“梦想”“自由”等 10 个主题,并要求自己针对这些主题分别进行模仿。

但完整的思考过程结束后,Kimi 产出了 10 段文本,且几乎句式完全相同。其中 9 段是以“xx 如 xx”这样的形式开头的。在模仿鲁迅这件事上,Kimi 深知不能失去比喻,就如同西方不能失去耶路撒冷一样。

看起来很像我爸会发在朋友圈,然后感慨自己青春不再的文案。

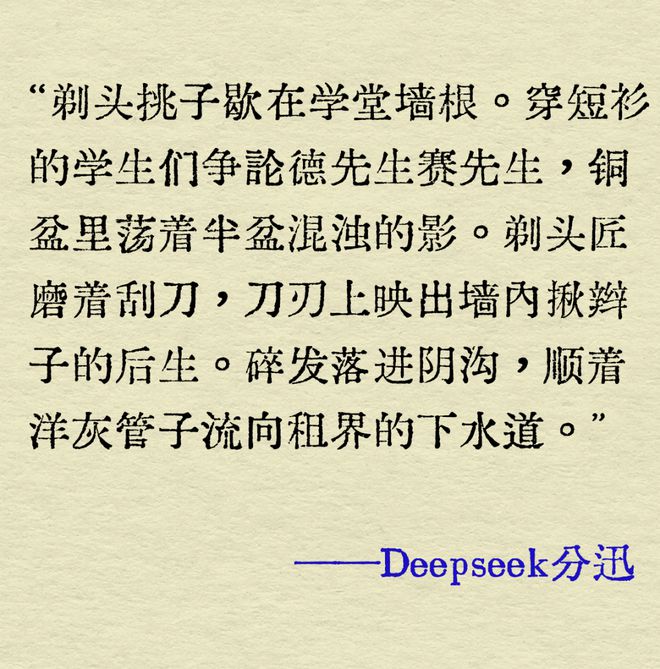

DeepSeek 的思考过程与 Kimi 相近,然而它的具体方案未聚焦于段落主题,而是直接聚焦在“核心意象”上,要求自身运用长衫、辫子、茶馆等元素,同时注重语言的凝练与节奏感,以增强批判的力度。尽管方案看上去较为完备,但在实践过程中,DeepSeek 明显未能克制住“极繁主义”的本质。

DeepSeek 在一段 85 字的文本中使用了 18 个名词,它通过意象的堆砌展示了词汇拼贴的能力,却将自己思考过的语言要点完全抛在脑后,从而露出了类似 AI 鲁迅的破绽。

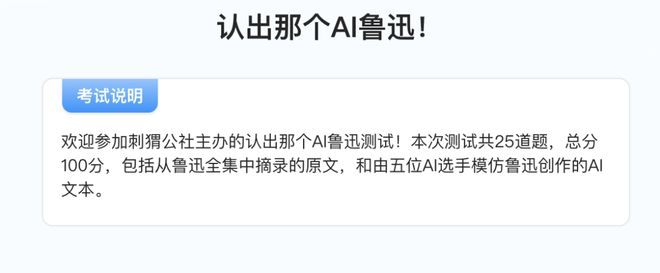

已知是 AI 生成的文本,我们就能够找出每位 AI 选手在模仿作家时的不足之处。然而,如果将真假作家的文本打乱混在一起,人类读者能够凭借敏锐的洞察力识别出碳基和硅基创作者的差别吗?

认出那个假鲁迅

本次 AI 作家测试,邀请了我的老板 Tim 和我的同桌园长来担任测试嘉宾。Tim 是湖南人,他最喜欢的中国现当代作家是沈从文,这是很合理的;园长毕业于复旦,他最喜欢张爱玲,但他说这与学校的研究浪潮并无关联。

测试结果表明,当前 AI 模仿作家风格所生成的新文本,根本无法骗过那些作家的读者。

确认他们各自熟悉的作家之后,我指挥五位“AI 牛马”。五位“AI 牛马”分别模仿沈从文的风格和张爱玲的风格,然后各自生成 10 段新内容。并且我要求“不要只是在原文基础上简单改写几个字,而是要模仿 XX 的风格,生成新的内容”。与此同时,我准备了若干条沈从文的文本和若干条张爱玲的文本,为避免影响测试结果,我避开了两位作家的热门作品。

完成语料准备工作后,我将 50 条 AI 版作家语料与随机数量的真作家语料进行打散排列,使其变成一套测试题。接着,我把这套测试题分别交给了 Tim 和园长。最终的测试结果表明,在 50 段 AI 沈从文和 50 段 AI 张爱玲中,没有任何一条能够成功蒙混过关,被测试者 100%判断为 AI 生成。

Tim 在 5 分钟内完成了测试。复盘时,他对自己的判断标准进行了详细解释。其一,但凡用到“美好”这个词的,都被他全部排除掉了,因为他认为沈从文那个时期不太可能使用这个词。其二,对于意象堆叠的情况,有些段落会把很多意象堆叠在一起,但一般成熟的作家都追求文字的简洁性,所以不太可能进行很多无用的堆叠。首先是意象的选择方面,优秀的作家必然会挑选具有创造性的意象,然而 AI 却会选取许多陈旧且重复的词汇。基于上述三条标准,Tim 迅速地找到了全部 50 条由不同 AI 模拟出来的沈从文的创作。

园长补充了另一种判断方式,那就是直觉。他说:“很明显水平不行的,是(AI)写的段落,就像一个刚开始学习写小说的人写出来的那样。即便我不是张爱玲的爱好者,仅仅看过一两篇张爱玲的小说,也能够分辨得出来。”

两位碳基测试者完成测试之后,我突然产生了好奇,那就是硅基选手自身能否区分出 AI 文本的文风呢?接着我把五位 AI 选手仿写的鲁迅片段,逐一投喂给了 DeepSeek。

结果,它将豆包分迅视为钱钟书,觉得 Kimi 分迅的题材带有鲁迅的痕迹且接近王小波;把文心一言分迅当作郁达夫,认为 GPT 分迅融合了鲁迅、余华和王小波三位作家的风格。最为幽默的是,它把自己刚刚模仿鲁迅创作出来的文本,当成了张爱玲、施蛰存和白先勇的结合体。

大家如果也想测试自己识别假鲁迅的能力,欢迎将页面拉到文末,然后点击“阅读原文”,去试试这套真假鲁迅测试题。

日常语料,才是AI编造重灾区

论文、小说、报告、新闻等领域的 AI 写作容易引发广泛讨论。然而事实上,那些由职业人类写作者(暂且用此身份称呼他们)完成的文本内容,对于当前的硅基写手而言,仍具有很高的模仿难度。文本可能更长且结构更复杂,对前后文的一致性以及逻辑关系有着更高的要求;或许需要去获取新的信息,以生产出新知识;要是属于成熟作家的创作,还会具备强烈的个人风格,而 AI 在编造过程中更容易暴露出破绽。

更何况,受众对于由 AI 生产的严肃内容或长内容,有着更强的辨别意愿。同时,也存在着更多明文规定的限制、约束以及惩罚措施。

相比之下,互联网上充斥的日常语料是 AI 文本真正的重灾区。复杂文本与之相比,日常语料具有适宜 AI 生存的特征条件,比如文本较短、语境较为轻松、辨别成本较高、用户的辨别意愿较低。

例如社交平台的短内容。

批量生产的八卦新闻和家庭故事在围攻社交平台。前者偶尔会出现事实性错误,这会暴露其硅基面目。后者因为涉及个人隐私,很难被证伪,只能激发无限猜测。儿媳与恶婆婆争斗,妻子抓住出轨渣男,情节离奇,细节生动。一半用户随着情绪起伏,另一半用户则怀疑这只是为了“起号”,甚至在留言区抓狂地发问:“你这是不是 AI 写的啊?”纯想知道自己猜得对不对。”

又例如新闻、短视频、图文内容的评论区。

微博有罗伯特,小红书有点点。这些 AI 内容助手在评论区十分活跃,用户都能清楚知晓它们是 AI,不存在混淆的情况。然而,还有大量由 AI 生成的日常语料,它们顶着随机生成的头像和用户名,以仿佛活人的姿态混入了评论区。

Tim有观看新闻的习惯。今年开始后,他留意到新闻的评论区里,增添了许多“假人所说的话”以及“虚假的内容”。

从内容方面来看,像“詹姆斯今天打得真不错”这样只有一句话的评论,很难让人怀疑其是否由 AI 发布。Tim 最初发现问题,是由于他在评论区看到了很多标点符号齐全、句式结构完整的句子。我们通常正常说话不会如此循规蹈矩。于是他点进那个用户的个人主页,发现该用户在一分钟内就在很多条新闻下面发了评论,并且这些评论都与新闻相关。人肯定无法在一分钟内看完这么多篇幅的内容,也无法写出这么多的评论。基于此,我就对它是否为机器人产生了怀疑。

AI 会伪装成人类与用户互动,这种情况在很多内容平台上都存在,并且比 GPT 的出现还要早。有互联网行业从业者向刺猬公社透露,在五、六年前就已经有这样的行为了,会生成一堆用户头像和用户名,然后去那些粉丝数量较少的用户的评论区留言。那时候 AI 生成的留言还很难做到个性化,只能使用一些通用的话语,比如“真棒”“今天真不错”,或者发送一堆表情包。大模型出现后,理论上讲,AI能伪装得更像了。”

那么谁会有动机去生产 AI 评论并制造虚构的互动呢?上述从业者向刺猬公社表示,有可能是所谓的“水军”,也有这种可能是平台本身。“水军属于第三方,市场上存在增加评论量的需求,他们就会去生产,而用 AI 比用人要高效得多。”平台的动机在于促活跃,主要聚焦于低粉用户的内容。能火起来的内容数量极少,处于金字塔底座上的那些内容,或许从始至终都不会获得一条留言。为激励这些用户持续生产并保持活跃,部分平台会采用一些科技手段。

至此,这不再仅仅是“AI 幻觉”方面的问题了。人类的日常语料被不断地稀释。我们在刷着由 AI 刚刚编写的婆媳关系帖子。给新闻评论区的 AI 评论点了一个赞。又收到了一条 AI 留言的提醒。或许人类才是一种幻觉。

我们不能每次都拿鲁迅、沈从文、张爱玲这样的名字来应对,就如同达摩祖师不可能从开始一直打到结束。

编造并非由 AI 带来,对 AI 稀释人类语料的这种担忧,也不代表一种反 AI 的立场。当观察人类语料被 AI 稀释的过程时,会让我不断回想起《现代性与大屠杀》的阅读记忆。如果不加以修正,人类语料所将要经历的“大屠杀”,或许会成为 AI 时代的一种潜在可能。