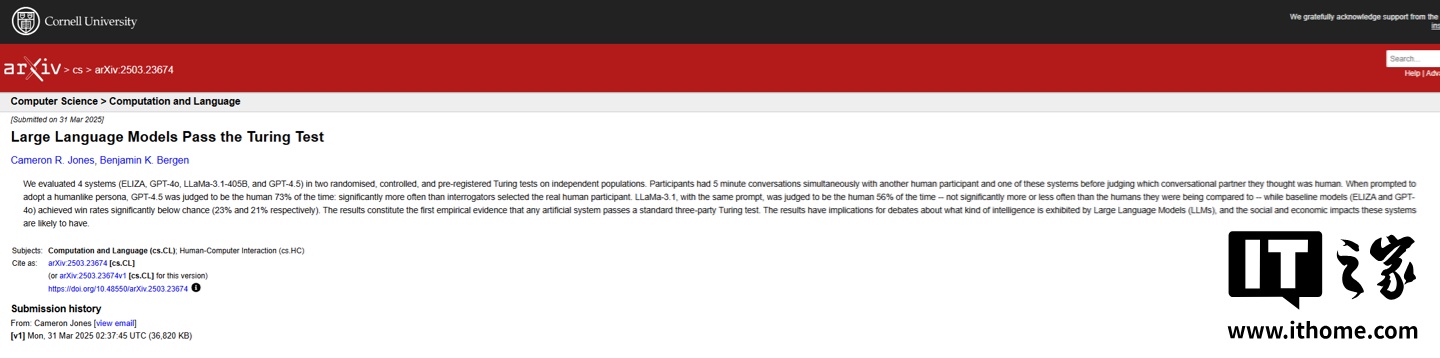

美国加州大学圣地亚哥分校在 4 月 2 日发布了一项研究成果。该成果宣称首次提供了相关实证证据,即人工智能系统能够通过标准三方图灵测试。

英国数学家和计算机科学家阿兰・图灵在 1950 年提出了图灵测试,他将其称为“模仿游戏”。图灵设想,当一名提问者在通过文本进行交流时,若无法分辨出对方是机器还是人类,那么这个机器或许具备类似人类的智能。在三方图灵测试里,提问者需要分别与一名人类以及一台机器展开对话,并准确地辨识出人类的身份。

IT 之家了解到,这项研究对三款人工智能模型进行了测试,分别是 OpenAI 的 GPT-4.5、meta 的 Llama 3.1 405B 以及 OpenAI 的 GPT-4o。在实验里,人类参与者通过分屏界面,与一名人类以及一台 AI 系统展开五分钟的测试对话。每一轮结束之后,提问者要判断哪一方是人类。

研究人员评估了这些 AI 模型在两种条件下的表现。一种条件是基础指令(NO-PERSONA)模式,另一种条件是增强型 PERSONA 模式,在增强型 PERSONA 模式下,AI 会模拟特定的人类行为特征。结果表明,在 PERSONA 模式时,GPT-4.5 的胜率是 73%,这显示提问者经常把它误认成人类;Llama 3.1-405B 的胜率大概是 56%;而在 NO-PERSONA 模式下,GPT-4o 的胜率仅有 21%。

在对话里,提问者主要是进行日常的闲聊。其中,有 61%的互动是在询问日常生活以及个人的细节。同时,有 50%的互动深入地探讨了社会和情感层面的内容,像观点、情感、幽默感以及个人经历等。

研究报告表明:提问者若不能可靠地将人类与机器区分开来,那么那台机器就会被认定为通过了图灵测试。基于这样的逻辑,GPT-4.5 在启用 PERSONA 模式时通过了图灵测试,Llama 3.1-405B 在启用 PERSONA 模式时也通过了图灵测试。

研究作者认为,这些 AI 系统有希望在那些依赖简短对话的经济角色里,既能无缝地补充人类劳动力,又能取代人类劳动力。他们还表示:更广泛来讲,这些系统或许会成为难以分辨的替代品,可适用于从与在线陌生人的对话,到和朋友的交流、和同事的交流,乃至和浪漫伴侣的交流等各类社交场景。